Modèle de transfert d'informations via des canaux techniques. Transfert d'informations via des canaux de communication techniques. Ressources d'information sur Internet. Canaux de transfert d'informations

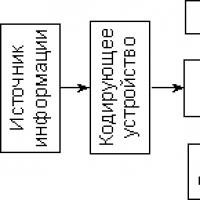

Schématiquement, le processus de transfert d'informations est illustré sur la figure. On suppose qu'il y a une source et un destinataire de l'information. Le message de la source au destinataire est transmis via un canal de communication (canal d'information).

Riz. 3. - Processus de transfert d'informations

Dans un tel processus, les informations sont présentées et transmises sous la forme d'une certaine séquence de signaux, symboles, signes. Par exemple, lors d'une conversation directe entre des personnes, des signaux sonores sont transmis - la parole, lors de la lecture d'un texte, une personne perçoit des lettres - des symboles graphiques. La séquence transmise est appelée un message. De la source au récepteur, le message est transmis à travers un support matériel (son - ondes acoustiques dans l'atmosphère, image - ondes électromagnétiques lumineuses). Si des moyens techniques de communication sont utilisés dans le processus de transmission, ils sont appelés canaux d'information(canaux d'information). Ceux-ci incluent le téléphone, la radio, la télévision.

On peut dire que les sens humains jouent le rôle de canaux d'information biologiques. Avec leur aide, l'impact de l'information sur une personne est ramené à la mémoire.

Claude Shanon, un schéma du processus de transmission d'informations via des canaux de communication techniques a été proposé, illustré sur la figure.

Riz. 4. - Processus de transfert d'informations Shannon

Le fonctionnement d'un tel système peut être expliqué dans le processus de conversation au téléphone. La source d'information est la personne qui parle. Un encodeur est un microphone combiné qui convertit les ondes sonores (parole) en signaux électriques. Le canal de communication est le réseau téléphonique (fils, commutateurs de nœuds téléphoniques par lesquels passe le signal)). Le dispositif de décodage est le combiné (casque) de la personne qui écoute - le récepteur de l'information. Ici, le signal électrique entrant est converti en son.

La communication dans laquelle la transmission a lieu sous la forme d'un signal électrique continu est appelée communication analogique.

En dessous de codage toute transformation d'une information provenant d'une source en une forme adaptée à sa transmission sur un canal de communication est comprise.

Actuellement, la communication numérique est largement utilisée, lorsque les informations transmises sont codées sous forme binaire (0 et 1 sont des chiffres binaires), puis décodées en texte, image, son. La communication numérique est discrète.

Le terme "bruit" fait référence à divers types d'interférences qui déforment le signal transmis et entraînent une perte d'informations. De telles interférences surviennent tout d'abord pour des raisons techniques : mauvaise qualité des lignes de communication, insécurité les uns des autres des différents flux d'informations transmis sur les mêmes canaux. Dans de tels cas, une protection contre le bruit est nécessaire.

Tout d'abord, des méthodes techniques sont utilisées pour protéger les canaux de communication des effets du bruit. Par exemple, utiliser un câble blindé au lieu d'un fil nu ; l'utilisation de différents types de filtres qui séparent le signal utile du bruit, etc.

Claude Shannon a développé une théorie de codage spéciale qui fournit des méthodes pour traiter le bruit. L'une des idées importantes de cette théorie est que le code transmis sur la ligne de communication doit être redondant. De ce fait, la perte d'une partie des informations pendant la transmission peut être compensée.

Cependant, la redondance ne doit pas être trop importante. Cela entraînera des retards et des coûts de communication plus élevés. La théorie du codage de K. Shannon permet juste d'obtenir un tel code qui sera optimal. Dans ce cas, la redondance des informations transmises sera la plus faible possible, et la fiabilité des informations reçues sera maximale.

Dans les systèmes de communication numériques modernes, la technique suivante est souvent utilisée pour lutter contre la perte d'informations lors de la transmission. L'ensemble du message est divisé en portions - blocs. Pour chaque bloc, une somme de contrôle (la somme des chiffres binaires) est calculée, qui est transmise avec ce bloc. Au lieu de réception, la somme de contrôle du bloc reçu est recalculée, et si elle ne correspond pas à l'original, la transmission de ce bloc est répétée. Cela continuera jusqu'à ce que les sommes de contrôle initiales et finales correspondent.

Taux de transfert d'informations est le volume d'information du message transmis par unité de temps. Unités de débit d'information : bit/s, octet/s, etc.

Les lignes de communication d'informations techniques (lignes téléphoniques, communication radio, câble à fibre optique) ont une limite de débit de données appelée bande passante du canal d'information. Les limites de taux sont de nature physique.

|

Protection contre le bruit |

Le fonctionnement de ce schéma peut être expliqué par l'exemple de la communication téléphonique. La source d'information dans ce système est la personne qui parle, le récepteur, respectivement, l'auditeur. L'encodeur est un combiné qui convertit les signaux sonores en signaux électromagnétiques. Le canal de communication est le réseau téléphonique. Le dispositif de décodage est également un combiné.

Codage des signaux, lors de la transmission d'informations, est toute transformation d'informations provenant d'une source en une forme adaptée à sa transmission sur un canal de communication. Actuellement, la communication numérique la plus utilisée, qui, par définition, est discrète. De plus, il existe également une connexion analogique, c'est une connexion dans laquelle les informations sont transmises sous la forme d'un signal continu (anciennes normes de réseau téléphonique).

En dessous de " Bruit" divers types d'interférences déformant le signal transmis ou entraînant sa perte sont impliqués. De telles interférences surviennent le plus souvent pour des raisons techniques : mauvaise qualité des lignes de communication, insécurité les uns des autres des différents flux d'informations transmis sur un même canal de communication.

Méthodes de gestion du "bruit":

1. Répétition du signal

2. Numérisation du signal

3. Amplification du signal

4. Moyens mécaniques (paire torsadée, fibre optique, blindage, etc.)

De plus, la théorie du codage a développé des méthodes de représentation de l'information transmise afin de réduire sa perte sous l'influence du bruit.

5.2. Réseaux informatiques

Réseau informatique est la connexion de deux ordinateurs ou plus entre eux pour partager l'accès à des ressources partagées. Il existe trois types de ressources : matérielles, logicielles et informationnelles

En dessous de ressources matérielles il implique la mise à disposition technique d'un accès général : une imprimante, une capacité accrue d'un disque dur (serveur de fichiers), une machine hôte, etc.

De manière générale, un réseau informatique peut être représenté comme un ensemble de nœuds interconnectés par des supports de propagation des signaux (supports de transmission, backbones, lignes de communication). Les nœuds de réseau informatique hébergent des éléments de réseau de communication et des systèmes informatiques.

Réseaux de communication. Les principaux éléments des réseaux de communication traditionnels sont les terminaux (terminaux), les systèmes de transmission et de commutation.

Terminaux conçu pour connecter les sources et les récepteurs d'informations au réseau de communication. Par exemple, les ordinateurs peuvent y être connectés via une ligne bifilaire dédiée ou via un modem.

système de transmission permet le transport d'informations à distance. Ils prennent actuellement en charge la signalisation multicanal sur une seule dorsale.

Système de commutation est conçu pour assurer la communication d'une pluralité de sources et de récepteurs d'informations spatialement séparés. Grâce à des systèmes de commutation interconnectés, un canal de communication composite (de bout en bout) est formé pour les participants

Chaque réseau public a son propre protocoles, donnant accès à certains types de services.

protocoles. En dessous de protocole est compris comme un ensemble d'accords qui guident les composants lorsqu'ils interagissent. Dans notre cas protocole il existe un ensemble de règles standard qui définissent la présentation (dans un cas particulier, les formats) des données et les procédures d'échange

Le processus de transfert d'informations peut être représenté au moyen d'un modèle sous la forme d'un schéma illustré à la figure 3.

Riz. 3. Modèle généralisé de système de transmission d'informations

Considérez les principaux éléments qui composent ce modèle, ainsi que la transformation de l'information qui s'y produit.

1. Source de l'information ou du message (IA) est un objet matériel ou un sujet d'information capable d'accumuler, de stocker, de transformer et d'émettre des informations sous forme de messages ou de signaux de diverses natures physiques. Il peut s'agir d'un clavier d'ordinateur, d'une personne, d'une sortie analogique d'une caméra vidéo, etc.

Nous considérerons deux types de sources d'information : si dans un intervalle de temps fini la source d'information va créer un ensemble fini de messages, il est discret , et sinon - continu . Nous discuterons des sources plus en détail dans la prochaine leçon.

Les informations sous la forme du message d'origine provenant de la sortie de la source d'informations sont transmises à l'entrée du codeur, y compris le codeur de source (CI) et le codeur de canal (CC).

2. Encodeur.

2.1.Encodeur source fournit la transformation du message en signal primaire - un ensemble de symboles élémentaires .

Notez que le code est un moyen universel d'afficher des informations lors de son stockage, de sa transmission et de son traitement sous la forme d'un système de correspondances biunivoques entre les éléments de message et les signaux, à l'aide duquel ces éléments peuvent être fixés. L'encodage peut toujours se réduire à la transformation sans ambiguïté des caractères d'un alphabet en caractères d'un autre. En même temps, le code est une règle, une loi, un algorithme selon lequel s'effectue cette transformation.

Le code est un ensemble complet de toutes les combinaisons possibles de symboles de l'alphabet secondaire, construit selon cette loi. Les combinaisons de caractères appartenant à un code donné sont appelées mots de code . Dans chaque cas particulier, tout ou partie des couches de code appartenant à un code donné peuvent être utilisées. De plus, il existe des "codes puissants", dont toutes les combinaisons sont presque impossibles à afficher. Par conséquent, par le mot "code", nous entendons tout d'abord la loi selon laquelle la transformation est effectuée, à la suite de laquelle nous obtenons des mots de code, dont l'ensemble complet appartient à ce code, et non à certains l'autre construit selon une loi différente.

Les symboles de l'alphabet secondaire, quelle que soit la base du code, ne sont que des porteurs de messages. Dans ce cas, le message est la lettre de l'alphabet primaire, quel que soit le contenu physique ou sémantique spécifique qu'il reflète.

Ainsi, le but du codeur source est de présenter les informations sous la forme la plus compacte. Ceci est nécessaire pour utiliser efficacement les ressources du canal de communication ou du dispositif de stockage. Les problèmes de codage de source seront abordés plus en détail dans le sujet n ° 3.

2.2.Encodeur de canal. Lors de la transmission d'informations sur un canal de communication bruyant, des erreurs peuvent se produire dans les données reçues. Si de telles erreurs sont de faible ampleur ou se produisent assez rarement, les informations peuvent être utilisées par le consommateur. Avec un grand nombre d'erreurs, les informations reçues ne peuvent pas être utilisées.

Encodage de canal, ou codage correcteur d'erreurs, est une méthode de traitement des données transmises, fournissant diminuer nombre d'erreurs survenant lors de la transmission sur un canal bruyant.

À la sortie de l'encodeur de canal, une séquence de symboles de code est ainsi formée, appelée séquence de code . Les problèmes de codage de canal seront abordés plus en détail dans le thème n° 5, ainsi que dans le cours "Théorie de la communication électrique".

Il convient de noter que le codage correcteur d'erreurs et la compression des données ne sont pas des opérations obligatoires dans la transmission des informations. Ces procédures (et leurs blocs correspondants dans le schéma fonctionnel) peuvent ne pas être présentes. Cependant, cela peut entraîner des pertes très importantes de l'immunité au bruit du système, une diminution importante du débit de transmission et une diminution de la qualité de transmission des informations. Par conséquent, pratiquement tous les systèmes modernes (à l'exception peut-être des plus simples) doivent inclure et incluent nécessairement un codage de données à la fois efficace et correcteur d'erreurs.

3. Modulateur. S'il est nécessaire de transmettre des messages, les symboles de l'alphabet secondaire sont dotés de caractéristiques physiques qualitatives spécifiques. Le processus d'influencer un message codé afin de le transformer en un signal est appelé modulation . Fonctions modulateur - négociation de messages la source ou des séquences de code générées par l'encodeur, co propriétés de la ligne de communication et permettre la transmission simultanée d'un grand nombre de messages sur un canal de communication commun.

Par conséquent, le modulateur doit convertir des messages source ou leurs séquences de code correspondantes en signaux, (pour superposer des messages sur des signaux), dont les propriétés leur fourniraient la possibilité d'une transmission efficace sur les canaux de communication existants. Dans ce cas, les signaux appartenant à une pluralité de systèmes de transmission d'informations fonctionnant, par exemple, dans un canal radio commun, doivent être tels qu'une transmission indépendante des messages de toutes les sources vers tous les destinataires des informations est assurée. Diverses méthodes de modulation sont étudiées en détail dans le cours "Théorie de la communication électrique".

On peut dire que le rendez-vous encodeur et modulateur est la coordination de la source d'information avec la ligne de communication.

4. Ligne de communication est le milieu dans lequel se propagent les signaux porteurs d'informations. Ne pas confondre canal de communication et ligne de communication. Lien - un ensemble de moyens techniques destinés à transmettre des informations d'une source à un destinataire.

Selon le support de propagation, il existe des canaux radio, filaires, fibre optique, acoustiques, etc. canaux. Il existe de nombreux modèles décrivant les canaux de communication avec plus ou moins de détails, cependant, dans le cas général, le signal traversant le canal de communication subit une atténuation, acquiert un certain retard (ou déphasage) et devient bruyant.

Pour augmenter le débit des lignes de communication, les messages provenant de plusieurs sources peuvent être transmis simultanément à travers celles-ci. Cette approche est appelée sceller. Dans ce cas, les messages de chaque source sont transmis sur leur propre canal de communication, bien qu'ils aient une ligne de communication commune.

Les modèles mathématiques des canaux de communication seront abordés dans le cours "Théorie de la communication électrique". Les caractéristiques informationnelles des canaux de communication seront examinées en détail dans le cadre de notre discipline lors de l'étude du sujet n°4.

5. Démodulateur . Le message reçu (reproduit), en raison de la présence d'interférences, diffère généralement de celui envoyé. Le message reçu sera appelé une estimation (c'est-à-dire une estimation du message).

Pour reproduire l'évaluation du message, le récepteur du système doit d'abord selon le swing accepté et en tenant compte des informations sur les données utilisées dans le transfert la forme d'un signal et méthode de modulation obtenir une estimation de la séquence de code, appelé séquence acceptée. Cette procédure est appelée démodulation, détection ou réception de signal. Dans ce cas, la démodulation doit être effectuée de manière à ce que la séquence reçue diffère au minimum de la séquence de code transmise. Les problématiques de réception optimale des signaux dans les systèmes d'ingénierie radio font l'objet d'étude du cours TES.

6. Décodeur.

6.1. Décodeur de canal. Les séquences reçues peuvent généralement différer des mots de code transmis, c'est-à-dire qu'elles peuvent contenir des erreurs. Le nombre de telles erreurs dépend du niveau d'interférence dans le canal de communication, du débit de transmission, du signal sélectionné pour la transmission et de la méthode de modulation, ainsi que de la méthode de réception (démodulation). Tâche du décodeur de canal- détecter et, si possible, corriger ces erreurs. La procédure de détection et de correction des erreurs dans la séquence reçue est appelée décodage de canal . Le résultat du décodage est l'évaluation de la séquence d'informations. Le choix du code de correction d'erreur, de la méthode de codage et de la méthode de décodage doit être fait de manière à ce que la sortie du décodeur de canal comporte le moins d'erreurs non corrigées possible.

Les problèmes de codage/décodage correcteur d'erreurs dans les systèmes de transmission (et de stockage) de l'information font actuellement l'objet d'une attention particulière, car cette technique permet d'améliorer considérablement la qualité de sa transmission. Dans de nombreux cas, lorsque les exigences de fiabilité des informations reçues sont très élevées (dans les réseaux informatiques pour la transmission de données, dans les systèmes de télécommande, etc.), la transmission sans codage correcteur d'erreurs est généralement impossible.

6.2. Décodeur source. Étant donné que l'information source a été codée lors de la transmission afin d'avoir une représentation plus compacte (ou plus pratique) ( compression des données, codage économique, encodage source), il faut lui redonner sa forme originale (ou presque originale) selon la séquence acceptée. Le processus de récupération s'appelle décodage source et peut soit être simplement l'inverse de l'opération d'encodage (encodage/décodage non destructif) soit restituer une valeur approchée de l'information d'origine. L'opération de récupération comprendra également la récupération, si nécessaire, d'une fonction continue à partir d'un ensemble de valeurs discrètes d'estimations.

Il faut dire que récemment, le codage économique est devenu de plus en plus important dans les systèmes de transmission d'informations, car, avec le codage correcteur d'erreurs, cela s'est avéré être le moyen le plus efficace d'augmenter la vitesse et la qualité de sa transmission.

7.Destinataire des informations - un objet matériel ou un sujet qui perçoit des informations sous toutes leurs formes de manifestation aux fins de leur traitement ultérieur et de leur utilisation.

Les destinataires des informations peuvent être aussi bien des personnes que des moyens techniques qui accumulent, stockent, transforment, transmettent ou reçoivent des informations.

Le transfert d'informations est un terme qui combine de nombreux processus physiques de mouvement d'informations dans l'espace. Chacun de ces processus implique des composants tels que la source et le récepteur des données, le support physique de l'information et le canal (support) de sa transmission.

Processus de transfert d'informations

Les réceptacles initiaux des données sont divers messages transmis de leurs sources aux récepteurs. Entre eux se trouvent des canaux de transmission d'informations. Des dispositifs de conversion techniques spéciaux (encodeurs) forment des supports de données physiques - des signaux - basés sur le contenu des messages. Ces derniers subissent un certain nombre de transformations, dont le codage, la compression, la modulation, puis sont envoyés sur les lignes de communication. Après les avoir traversés, les signaux subissent des transformations inverses, y compris la démodulation, la décompression et le décodage, à la suite desquelles les messages d'origine en sont extraits et perçus par les récepteurs.

Messages d'information

Un message est une sorte de description d'un phénomène ou d'un objet, exprimé comme un ensemble de données qui a des signes de début et de fin. Certains messages, tels que la parole et la musique, sont des fonctions continues du temps de pression acoustique. Dans les communications télégraphiques, un message est le texte d'un télégramme sous la forme d'une séquence alphanumérique. Un message télévisé est une séquence d'images-messages que l'objectif de la caméra "voit" et les capture à une fréquence d'images. La grande majorité des messages transmis récemment par les systèmes de transmission d'informations sont des tableaux numériques, du texte, des graphiques, ainsi que des fichiers audio et vidéo.

Signaux d'information

La transmission d'informations est possible si elle a un support physique dont les caractéristiques changent en fonction du contenu du message transmis de telle manière qu'elles surmontent le canal de transmission avec une distorsion minimale et peuvent être reconnues par le récepteur. Ces changements dans le support de stockage physique forment un signal d'information.

Aujourd'hui, les informations sont transmises et traitées à l'aide de signaux électriques dans les canaux de communication filaires et radio, ainsi que grâce à des signaux optiques dans FOCL.

Signaux analogiques et numériques

Un exemple bien connu de signal analogique, c'est-à-dire changeant continuellement dans le temps est la tension prélevée sur le microphone, qui transmet un message d'information vocale ou musicale. Il peut être amplifié et câblé aux systèmes de sonorisation de la salle de concert, qui transporteront la parole et la musique de la scène au public de la galerie.

Si, conformément à l'amplitude de la tension à la sortie du microphone, l'amplitude ou la fréquence des oscillations électriques à haute fréquence dans l'émetteur radio est continuellement modifiée dans le temps, un signal radio analogique peut être transmis sur les ondes. L'émetteur TV du système de télévision analogique génère un signal analogique sous la forme d'une tension proportionnelle à la luminosité actuelle des éléments d'image perçus par l'objectif de la caméra.

Cependant, si la tension analogique de la sortie du microphone passe par un convertisseur numérique-analogique (DAC), alors sa sortie ne sera plus une fonction continue du temps, mais une séquence de lectures de cette tension prises à intervalles réguliers avec une fréquence d'échantillonnage. De plus, le DAC effectue également une quantification en fonction du niveau de la tension initiale, remplaçant toute la plage possible de ses valeurs par un ensemble fini de valeurs déterminées par le nombre de chiffres binaires de son code de sortie. Il s'avère qu'une quantité physique continue (dans ce cas, il s'agit de la tension) se transforme en une séquence de codes numériques (numérisés), puis peut être stockée, traitée et transmise sous forme numérique via des réseaux de transmission d'informations. Cela augmente considérablement la vitesse et l'immunité au bruit de ces processus.

Canaux de transfert d'informations

Habituellement, ce terme fait référence aux complexes de moyens techniques impliqués dans la transmission des données de la source au récepteur, ainsi qu'à l'environnement entre eux. La structure d'un tel canal, utilisant des moyens typiques de transmission d'informations, est représentée par la séquence de transformations suivante :

II - PS - (KI) - KK - M - LPI - DM - DC - DI - PS

L'IA est une source d'information : une personne ou un autre être vivant, un livre, un document, une image sur un support non électronique (toile, papier), etc.

PS est un convertisseur de message d'information en signal d'information, qui effectue la première étape de la transmission de données. Les microphones, les caméras de télévision et vidéo, les scanners, les télécopieurs, les claviers de PC, etc. peuvent agir comme PS.

CI est un codeur d'informations dans un signal d'information pour réduire le volume (compression) d'informations afin d'augmenter son débit de transmission ou de réduire la bande de fréquences requise pour la transmission. Ce lien est facultatif, comme indiqué entre parenthèses.

KK - encodeur de canal pour augmenter l'immunité au bruit du signal informatif.

M est un modulateur de signal pour modifier les caractéristiques des signaux porteurs intermédiaires en fonction de la valeur du signal d'information. Un exemple typique est la modulation d'amplitude d'un signal porteur d'une fréquence porteuse élevée en fonction de la valeur d'un signal d'information basse fréquence.

LPI - une ligne de transmission d'informations représentant une combinaison de l'environnement physique (par exemple, un champ électromagnétique) et des moyens techniques pour changer son état afin de transmettre un signal porteur au récepteur.

DM est un démodulateur pour séparer le signal d'information du signal porteur. Présent uniquement en présence de M.

DC - décodeur de canal pour détecter et/ou corriger les erreurs dans le signal d'information qui se sont produites sur le LPI. Présent uniquement en présence de CC.

DI - décodeur d'informations. Présent uniquement en présence de CI.

PI - récepteur d'informations (ordinateur, imprimante, écran, etc.).

Si la transmission des informations est bidirectionnelle (canal duplex), il existe des deux côtés du LPI des unités de modem (MODulateur-DEModulateur) qui combinent des liaisons M et DM, ainsi que des unités de codec (COder-DEcoder) qui combinent des encodeurs (KI et KK) et décodeurs (DI et DC).

Caractéristiques des canaux de transmission

Les principales caractéristiques distinctives des canaux incluent la bande passante et l'immunité au bruit.

Dans le canal, le signal d'information est exposé au bruit et aux interférences. Ils peuvent être causés par des causes naturelles (par exemple, atmosphériques pour les chaînes radio) ou être spécialement créés par l'ennemi.

L'immunité au bruit des canaux de transmission est augmentée en utilisant divers types de filtres analogiques et numériques pour séparer les signaux d'information du bruit, ainsi que des méthodes de transmission de messages spéciales qui minimisent l'effet du bruit. L'une de ces méthodes consiste à ajouter des caractères supplémentaires qui ne contiennent pas de contenu utile, mais aident à contrôler l'exactitude du message, ainsi qu'à corriger les erreurs qu'il contient.

La bande passante du canal est égale au nombre maximal de symboles binaires (kbps) transmis par celui-ci en l'absence d'interférence en une seconde. Pour différents canaux, il varie de quelques kbps à des centaines de Mbps et est déterminé par leurs propriétés physiques.

Théorie du transfert d'informations

Claude Shannon est l'auteur d'une théorie spéciale sur le codage des données transmises, qui a découvert des méthodes de lutte contre le bruit. L'une des idées principales de cette théorie est la nécessité d'une redondance du code numérique transmis sur les lignes de transmission d'informations. Cela vous permet de restaurer la perte si une partie du code est perdue lors de sa transmission. De tels codes (signaux d'information numériques) sont dits insensibles au bruit. Cependant, la redondance de code ne doit pas être poussée trop loin. Cela conduit au fait que la transmission des informations est retardée, ainsi qu'à l'augmentation du coût des systèmes de communication.

Traitement des signaux numériques

Un autre élément important de la théorie de la transmission de l'information est un système de méthodes de traitement numérique du signal dans les canaux de transmission. Ces procédés comprennent des algorithmes pour numériser des signaux d'information analogiques initiaux avec un certain taux d'échantillonnage déterminé sur la base du théorème de Shannon, ainsi que des procédés pour générer, sur leur base, des signaux porteurs protégés contre le bruit pour une transmission sur des lignes de communication et un filtrage numérique des signaux reçus. afin de les séparer des interférences.

Le premier moyen technique de transmission d'informations à distance fut le télégraphe, inventé en 1837 par l'Américain Samuel Morse. En 1876, l'Américain A. Bell invente le téléphone. Basé sur la découverte des ondes électromagnétiques par le physicien allemand Heinrich Hertz (1886), A.S. Popov en Russie en 1895 et presque simultanément avec lui en 1896 G. Marconi en Italie, la radio est inventée. La télévision et Internet sont apparus au XXe siècle.

Toutes les méthodes techniques énumérées de communication d'informations sont basées sur la transmission d'un signal physique (électrique ou électromagnétique) à distance et sont soumises à certaines lois générales. L'étude de ces lois est théorie de la communication qui a émergé dans les années 1920. Appareil mathématique de la théorie de la communication - théorie mathématique de la communication, développé par le scientifique américain Claude Shannon.

Claude Elwood Shannon (1916–2001), États-Unis

Claude Shannon a proposé un modèle du processus de transmission d'informations par des canaux de communication techniques, représenté par un schéma.

Système de transmission d'informations techniques

Par codage, on entend ici toute transformation d'une information provenant d'une source sous une forme adaptée à sa transmission sur un canal de communication. Décodage- transformation inverse de la séquence signal.

Le fonctionnement d'un tel système peut s'expliquer par le processus familier de parler au téléphone. La source d'information est la personne qui parle. Un encodeur est un microphone combiné qui convertit les ondes sonores (parole) en signaux électriques. Le canal de communication est le réseau téléphonique (fils, commutateurs des nœuds téléphoniques par lesquels passe le signal). Le dispositif de décodage est un combiné (casque) de la personne qui écoute - le récepteur de l'information. Ici, le signal électrique entrant est converti en son.

Les systèmes informatiques modernes de transmission d'informations - les réseaux informatiques - fonctionnent sur le même principe. Il existe un processus de codage qui convertit un code informatique binaire en un signal physique du type qui est transmis sur un canal de communication. Le décodage est la transformation inverse du signal transmis en code informatique. Par exemple, lors de l'utilisation de lignes téléphoniques dans des réseaux informatiques, les fonctions de codage et de décodage sont assurées par un dispositif appelé modem.

Capacité du canal et taux de transfert d'informations

Les développeurs de systèmes de transmission d'informations techniques doivent résoudre deux tâches interdépendantes : comment assurer la plus grande vitesse de transfert d'informations et comment réduire la perte d'informations pendant la transmission. Claude Shannon a été le premier scientifique à s'attaquer à la solution de ces problèmes et à créer une nouvelle science pour cette époque - théorie de l'information.

K.Shannon a déterminé la méthode de mesure de la quantité d'informations transmises sur les canaux de communication. Ils ont introduit le concept Bande passante du canal,comme le taux de transfert d'informations maximal possible. Cette vitesse est mesurée en bits par seconde (ainsi qu'en kilobits par seconde, mégabits par seconde).

Le débit d'un canal de communication dépend de sa mise en œuvre technique. Par exemple, les réseaux informatiques utilisent les moyens de communication suivants :

lignes téléphoniques,

Connexion de câble électrique,

câblage de fibre optique,

Communication radio.

Débit des lignes téléphoniques - dizaines, centaines de Kbps ; le débit des lignes à fibres optiques et des lignes de communication radio se mesure en dizaines et en centaines de Mbps.

Bruit, protection contre le bruit

Le terme "bruit" fait référence à divers types d'interférences qui déforment le signal transmis et entraînent une perte d'informations. De telles interférences se produisent principalement pour des raisons techniques : mauvaise qualité des lignes de communication, insécurité les uns des autres des différents flux d'informations transmis sur les mêmes canaux. Parfois, en parlant au téléphone, nous entendons des bruits, des crépitements, qui rendent difficile la compréhension de l'interlocuteur, ou la conversation de personnes complètement différentes se superpose à notre conversation.

La présence de bruit entraîne la perte des informations transmises. Dans de tels cas, une protection contre le bruit est nécessaire.

Tout d'abord, des méthodes techniques sont utilisées pour protéger les canaux de communication des effets du bruit. Par exemple, utiliser un câble blindé au lieu d'un fil nu ; l'utilisation de différents types de filtres qui séparent le signal utile du bruit, etc.

Claude Shannon a développé théorie du codage, qui donne des méthodes pour traiter le bruit. L'une des idées importantes de cette théorie est que le code transmis sur la ligne de communication doit être redondant. De ce fait, la perte d'une partie des informations pendant la transmission peut être compensée. Par exemple, si vous êtes difficile à entendre lorsque vous parlez au téléphone, alors en répétant chaque mot deux fois, vous avez plus de chances que l'interlocuteur vous comprenne correctement.

Cependant, vous ne pouvez pas rendre la redondance trop importante. Cela entraînera des retards et des coûts de communication plus élevés. La théorie du codage permet d'obtenir un code qui sera optimal. Dans ce cas, la redondance des informations transmises sera la plus faible possible, et la fiabilité des informations reçues sera la plus élevée.

Dans les systèmes de communication numériques modernes, la technique suivante est souvent utilisée pour lutter contre la perte d'informations lors de la transmission. L'ensemble du message est divisé en parties - paquets. Pour chaque forfait est calculé somme de contrôle(somme de chiffres binaires) qui est transmis avec ce paquet. Au lieu de réception, la somme de contrôle du paquet reçu est recalculée et, si elle ne correspond pas à la somme d'origine, la transmission de ce paquet est répétée. Cela continuera jusqu'à ce que les sommes de contrôle initiales et finales correspondent.

Compte tenu du transfert d'informations dans les cours de propédeutique et d'informatique de base, ce sujet doit tout d'abord être abordé du point de vue d'une personne en tant que destinataire d'informations. La capacité de recevoir des informations du monde environnant est la condition la plus importante pour l'existence humaine. Les organes sensoriels humains sont les canaux d'information du corps humain, réalisant la connexion d'une personne avec l'environnement extérieur. Sur cette base, les informations sont divisées en visuelles, auditives, olfactives, tactiles et gustatives. La justification du fait que le goût, l'odorat et le toucher transmettent des informations à une personne est la suivante : nous nous souvenons des odeurs d'objets familiers, du goût d'aliments familiers, nous reconnaissons des objets familiers au toucher. Et le contenu de notre mémoire est constitué d'informations stockées.

Il faut dire aux élèves que dans le monde animal, le rôle informationnel des sens est différent de celui des humains. L'odorat remplit une fonction d'information importante pour les animaux. L'odorat accru des chiens d'assistance est utilisé par les forces de l'ordre pour rechercher des criminels, détecter des drogues, etc. La perception visuelle et sonore des animaux diffère de celle des humains. Par exemple, les chauves-souris sont connues pour entendre les ultrasons et les chats sont connus pour voir dans l'obscurité (d'un point de vue humain).

Dans le cadre de ce sujet, les étudiants doivent être capables de donner des exemples précis du processus de transmission d'informations, de déterminer pour ces exemples la source, le récepteur d'informations et les canaux utilisés pour transmettre des informations.

Lors d'études en informatique au lycée, les élèves doivent être initiés aux dispositions de base de la théorie technique de la communication: les concepts de codage, décodage, taux de transfert d'informations, capacité de canal, bruit, protection contre le bruit. Ces questions peuvent être abordées dans le cadre du thème « Moyens techniques des réseaux informatiques ».

Représentation numérique

Les nombres en mathématiques

Le nombre est le concept le plus important des mathématiques, qui a évolué et évolué au cours d'une longue période de l'histoire humaine. Les gens travaillent avec les nombres depuis l'Antiquité. Initialement, une personne n'opérait qu'avec des nombres entiers positifs, appelés nombres naturels: 1, 2, 3, 4, ... Pendant longtemps, il y avait une opinion selon laquelle il y avait le plus grand nombre, "plus que cela, l'esprit humain peut comprendre » (comme ils l'écrivaient dans les traités mathématiques de l'ancien slavon) .

Le développement de la science mathématique a conduit à la conclusion qu'il n'y a pas de plus grand nombre. D'un point de vue mathématique, la suite des nombres naturels est infinie, c'est-à-dire n'est pas limité. Avec l'avènement du concept de nombre négatif en mathématiques (R. Descartes, XVIIe siècle en Europe; en Inde beaucoup plus tôt), il s'est avéré que l'ensemble des nombres entiers est illimité à la fois «à gauche» et «à droite». L'ensemble mathématique des nombres entiers est discret et illimité (infini).

Le concept de nombre réel (ou réel) a été introduit en mathématiques par Isaac Newton au 18ème siècle. D'un point de vue mathématique l'ensemble des nombres réels est infini et continu. Il comprend de nombreux entiers et un nombre infini de non-entiers. Entre deux points quelconques sur l'axe des nombres se trouve un ensemble infini de nombres réels. La notion de nombre réel est associée à l'idée d'un axe numérique continu dont tout point correspond à un nombre réel.

Représentation entière

Dans la mémoire de l'ordinateur les nombres sont stockés dans un système de nombre binaire(cm. " Systèmes de numération” 2). Il existe deux formes de représentation des nombres entiers dans un ordinateur : les nombres entiers non signés et les nombres entiers signés.

Entiers sans signe - ce l'ensemble des nombres positifs dans la plage, où k- il s'agit de la profondeur de bits de la cellule mémoire allouée au numéro. Par exemple, si une cellule mémoire de 16 bits (2 octets) est allouée pour un entier, alors le plus grand nombre sera :

En décimal, cela correspond à : 2 16 - 1 \u003d 65 535

Si tous les chiffres de la cellule sont des zéros, alors ce sera zéro. Ainsi, 2 16 = 65 536 entiers sont placés dans une cellule de 16 bits.

Entiers signésest l'ensemble des nombres positifs et négatifs dans la plage[–2k –1 , 2k-Onze]. Par exemple, lorsque k= 16 gamme de représentation entière : [–32768, 32767]. L'ordre supérieur de la cellule mémoire stocke le signe du nombre : 0 - nombre positif, 1 - nombre négatif. Le plus grand nombre positif 32 767 a la représentation suivante :

Par exemple, le nombre décimal 255, après avoir été converti en binaire et inséré dans une cellule mémoire 16 bits, aura la représentation interne suivante :

Les entiers négatifs sont représentés en complément à deux. Code supplémentaire nombre positif N- ce telle sa représentation binaire, qui, ajoutée au code du nombre N, donne la valeur 2k. Ici k- le nombre de bits dans la cellule mémoire. Par exemple, le code supplémentaire pour le nombre 255 serait :

C'est la représentation du nombre négatif -255. Ajoutons les codes des nombres 255 et -255 :

Celui de l'ordre le plus élevé a «abandonné» de la cellule, de sorte que la somme s'est avérée être nulle. Mais c'est comme ça que ça devrait être : N + (–N) = 0. Le processeur de l'ordinateur effectue l'opération de soustraction sous la forme d'une addition avec le code supplémentaire du nombre soustrait. Dans ce cas, le débordement de la cellule (dépassement des valeurs limites) ne provoque pas l'interruption de l'exécution du programme. Cette circonstance que le programmeur doit connaître et prendre en compte !

Format de représentation des nombres réels dans un ordinateur appelé format virgule flottante. nombre réel R représenté comme un produit de la mantisse m basé sur le système de numération n dans une certaine mesure p, qui s'appelle l'ordre : R= m ? np.

La représentation d'un nombre sous forme de virgule flottante est ambiguë. Par exemple, pour le nombre décimal 25,324, les égalités suivantes sont vraies :

25,324 = 2,5324 ? 10 1 = 0,0025324 ? 10 4 \u003d 2532,4? 10 -2, etc...

Pour éviter toute ambiguïté, nous avons convenu d'utiliser l'ordinateur une représentation normalisée d'un nombre sous forme de virgule flottante. Mantisse dans la représentation normalisée doit satisfaire la condition : 0,1 n m < 1n. En d'autres termes, la mantisse est inférieure à un et le premier chiffre significatif n'est pas zéro. Dans certains cas, la condition de normalisation est prise comme suit : 1 n m < 10n.

V mémoire d'ordinateur mantisse représenté sous la forme d'un nombre entier ne contenant que des chiffres significatifs(0 entiers et virgules ne sont pas stockés). Ainsi, la représentation interne d'un nombre réel se réduit à la représentation d'un couple d'entiers : mantisse et exposant.

Différents types d'ordinateurs utilisent différentes manières de représenter les nombres sous forme de virgule flottante. Considérons l'une des variantes de la représentation interne d'un nombre réel dans une cellule mémoire de quatre octets.

La cellule doit contenir les informations suivantes sur le nombre : le signe du nombre, l'exposant et les chiffres significatifs de la mantisse.

Le signe du nombre est stocké dans le bit le plus significatif du 1er octet : 0 signifie plus, 1 signifie moins. Les 7 bits restants du premier octet contiennent commande de machines. Les trois octets suivants stockent les chiffres significatifs de la mantisse (24 bits).

Les nombres binaires compris entre 0000000 et 1111111 sont placés sur sept chiffres binaires, ce qui signifie que l'ordre de la machine varie entre 0 et 127 (en système décimal). Il y a 128 valeurs au total. L'ordre, évidemment, peut être positif ou négatif. Il est raisonnable de répartir ces 128 valeurs de manière égale entre les valeurs d'ordre positives et négatives : de -64 à 63.

Commande de machinesbiaisé par rapport au mathématique et n'a que des valeurs positives. Le décalage est choisi pour que la valeur mathématique minimale de la commande corresponde à zéro.

La relation entre l'ordre machine (Mp) et l'ordre mathématique (p) dans le cas considéré s'exprime par la formule : Mp = p + 64.

La formule résultante est écrite dans le système décimal. En binaire, la formule ressemble à : Mp 2 = p 2 + 100 0000 2 .

Pour écrire la représentation interne d'un nombre réel, il faut :

1) traduire le module d'un nombre donné en un système binaire à 24 chiffres significatifs,

2) normaliser un nombre binaire,

3) trouver l'ordre de la machine dans le système binaire,

4) en tenant compte du signe du nombre, écrivez sa représentation dans un mot machine de quatre octets.

Exemple.Écrivez la représentation interne du nombre 250,1875 sous forme de virgule flottante.

Solution

1. Traduisons-le en un système de numération binaire à 24 chiffres significatifs :

250,1875 10 = 11111010,0011000000000000 2 .

2. Écrivons sous la forme d'un nombre à virgule flottante binaire normalisé :

0.111110100011000000000000 H 10 2 1000 .

Voici la mantisse, la base du système numérique

(2 10 \u003d 10 2) et l'ordre (8 10 \u003d 1000 2) sont écrits en binaire.

3. Calculez l'ordre de la machine dans le système binaire :

MP2 = 1000 + 100 0000 = 100 1000.

4. Écrivons la représentation du nombre dans une cellule de mémoire de quatre octets, en tenant compte du signe du nombre

Forme hexadécimale : 48FA3000.

La gamme des nombres réels est beaucoup plus large que la gamme des nombres entiers. Les nombres positifs et négatifs sont disposés symétriquement autour de zéro. Par conséquent, les nombres maximum et minimum sont égaux en valeur absolue.

Le plus petit nombre absolu est zéro. Le plus grand nombre à virgule flottante en valeur absolue est le nombre avec la plus grande mantisse et le plus grand exposant.

Pour un mot machine de quatre octets, ce nombre serait :

0.111111111111111111111 10 2 1111111 .

Après conversion au système décimal, nous obtenons :

MAX = (1 - 2 -24) 2 63 10 19 .

Si, lors du calcul avec des nombres réels, le résultat est en dehors de la plage autorisée, l'exécution du programme est interrompue. Cela se produit, par exemple, lors de la division par zéro ou par un très petit nombre proche de zéro.

Les nombres réels dont la longueur en bits de la mantisse dépasse le nombre de bits alloués à la mantisse dans une cellule mémoire sont représentés dans le calculateur approximativement (avec une mantisse "tronquée"). Par exemple, le nombre décimal rationnel 0,1 dans un ordinateur sera représenté approximativement (arrondi) car dans le système binaire sa mantisse a un nombre infini de chiffres. La conséquence de cette approximation est l'erreur des calculs de la machine avec des nombres réels.

L'ordinateur effectue des calculs avec des nombres réels approximativement. L'erreur de ces calculs est appeléeerreur d'arrondi machine.

L'ensemble des nombres réels qui peuvent être exactement représentés dans la mémoire de l'ordinateur sous forme de virgule flottante est limité et discret.. La discrétion est une conséquence du nombre limité de chiffres de la mantisse, comme discuté ci-dessus.

Le nombre de nombres réels qui peuvent être exactement représentés dans la mémoire de l'ordinateur peut être calculé par la formule: N = 2t · ( tu – L+ 1) + 1. Ici t- le nombre de chiffres binaires de la mantisse ; tu- la valeur maximale de l'ordre mathématique ; L- valeur minimale de commande. Pour l'option de représentation considérée ci-dessus ( t = 24, tu = 63,

L= -64) il s'avère : N = 2 146 683 548.

Le thème de la représentation des informations numériques dans un ordinateur est présent à la fois dans la norme pour le primaire et pour le secondaire.

A l'école de base (cours de base), il suffit de considérer la représentation des nombres entiers dans un ordinateur. L'étude de cette question n'est possible qu'après s'être familiarisée avec le sujet «Systèmes de nombres». De plus, à partir des principes de l'architecture informatique, les étudiants doivent être conscients qu'un ordinateur fonctionne avec un système de numération binaire.

Compte tenu de la représentation des entiers, l'attention principale doit être portée sur la plage limitée d'entiers, sur la connexion de cette plage avec la capacité de la cellule mémoire allouée - k. Pour les nombres positifs (non signés) : , pour les nombres positifs et négatifs (signé) : [–2 k –1 , 2k –1 – 1].

L'obtention de la représentation interne des nombres doit être analysée à l'aide d'exemples. Après cela, par analogie, les élèves doivent résoudre ces problèmes de manière indépendante.

Exemple 1 Obtenez la représentation interne signée de l'entier 1607 dans un emplacement mémoire à deux octets.

Solution

1) Convertissez le nombre au système binaire : 1607 10 = 11001000111 2 .

2) En ajoutant des zéros aux 16 chiffres de gauche, on obtient la représentation interne de ce nombre dans la cellule :

Il est souhaitable de montrer comment la forme hexadécimale est utilisée pour la forme compressée de ce code, qui s'obtient en remplaçant chacun des quatre chiffres binaires par un chiffre hexadécimal : 0647 (voir " Systèmes de numération” 2).

Plus difficile est le problème d'obtention de la représentation interne d'un entier négatif (– N) - code supplémentaire. Vous devez montrer aux élèves l'algorithme de cette procédure :

1) obtenir la représentation interne d'un nombre positif N;

2) obtenir le code retour de ce numéro en remplaçant 0 par 1 et 1 par 0 ;

3) ajouter 1 au nombre obtenu.

Exemple 2 Obtenez la représentation interne de l'entier négatif -1607 dans un emplacement mémoire à deux octets.

Solution

Il est utile de montrer aux élèves à quoi ressemble la représentation interne du plus petit nombre négatif. Dans une cellule à deux octets, c'est -32 768.

1) il est facile de convertir le nombre 32 768 en système binaire, puisque 32 768 = 2 15. Donc en binaire c'est :

2) écrivez le code inverse :

3) ajouter un à ce nombre binaire, on obtient

Celui dans le premier bit signifie le signe moins. Pas besoin de penser que le code reçu est moins zéro. C'est -32 768 sous forme de complément à deux. Ce sont les règles de la représentation machine des nombres entiers.

Après avoir montré cet exemple, demandez aux élèves de prouver par eux-mêmes que l'addition des codes numériques 32767 + (-32768) donne le code numérique -1.

Selon la norme, la représentation des nombres réels devrait être étudiée au lycée. Lors de l'étude de l'informatique en 10e et 11e année au niveau de base, il suffit d'informer les élèves des principales caractéristiques d'un ordinateur avec des nombres réels : à propos de la plage limitée et de l'interruption du programme lorsqu'il la dépasse ; sur l'erreur des calculs de la machine avec des nombres réels, que l'ordinateur effectue des calculs avec des nombres réels plus lentement qu'avec des nombres entiers.

L'étude au niveau du profil nécessite une analyse détaillée de la façon de représenter des nombres réels au format à virgule flottante, une analyse des caractéristiques d'exécution de calculs sur un ordinateur avec des nombres réels. Un problème très important ici est l'évaluation de l'erreur de calcul, la prévention de la perte de valeur, de l'interruption du programme. Des informations détaillées sur ces questions sont disponibles dans le manuel de formation.

Notation

Notation - c'est une façon de représenter les nombres et les règles correspondantes pour opérer sur les nombres. Les différents systèmes de numération qui existaient auparavant et qui sont utilisés aujourd'hui peuvent être divisés en non positionnel et positionnel. Signes utilisés lors de l'écriture des nombres, sont appelés Nombres.

V systèmes de nombres non positionnels la valeur d'un chiffre ne dépend pas de sa position dans le nombre.

Un exemple de système de numération non positionnel est le système romain (chiffres romains). Dans le système romain, les lettres latines sont utilisées comme nombres :

Exemple 1 Le nombre CCXXXII est composé de deux cent trois dizaines et deux unités et est égal à deux cent trente deux.

Les chiffres romains s'écrivent de gauche à droite dans l'ordre décroissant. Dans ce cas, leurs valeurs sont ajoutées. Si un plus petit nombre est écrit à gauche et un grand nombre à droite, leurs valeurs sont soustraites.

Exemple 2

VI = 5 + 1 = 6 ; IV \u003d 5 - 1 \u003d 4.

Exemple 3

MCMXCVIII = 1000 + (-100 + 1000) +

+ (–10 + 100) + 5 + 1 + 1 + 1 = 1998.

V systèmes de numérotation positionnelle la valeur indiquée par un chiffre dans une entrée numérique dépend de sa position. Le nombre de chiffres utilisés est appelé la base du système de numération positionnel.

Le système de numération utilisé en mathématiques modernes est système décimal positionnel. Sa base est dix, car Tous les nombres sont écrits à l'aide de dix chiffres :

0, 1, 2, 3, 4, 5, 6, 7, 8, 9.

La nature positionnelle de ce système est facile à comprendre par l'exemple de n'importe quel nombre à plusieurs chiffres. Par exemple, dans le nombre 333, les trois premiers signifient trois cents, le deuxième - trois dizaines, le troisième - trois unités.

Écrire des nombres dans un système positionnel avec une base n Doit avoir alphabetà partir de n chiffres. Généralement pour cela n < 10 используют n premiers chiffres arabes, et n> 10 lettres sont ajoutées à dix chiffres arabes. Voici des exemples d'alphabets de plusieurs systèmes :

S'il est nécessaire d'indiquer la base du système auquel appartient le numéro, un indice est alors attribué à ce numéro. Par exemple:

1011012, 36718, 3B8F16.

Dans le système de numération de base q (q-ary number system) les unités de chiffres sont des puissances successives d'un nombre q. q les unités de n'importe quelle catégorie forment l'unité de la catégorie suivante. Pour écrire un nombre à q-système de numération aire requis q divers caractères (chiffres) représentant les chiffres 0, 1, ..., q– 1. Écrire un nombre q v q-le système numérique a la forme 10.

Transfert d'informations via des canaux de communication techniques

Transfert d'informations via des canaux de communication techniques Département de Biologie Médicale, Microbiologie, Virologie et Immunologie Adénovirus

Département de Biologie Médicale, Microbiologie, Virologie et Immunologie Adénovirus Présentation sur l'informatique "Qu'est-ce que la programmation ?

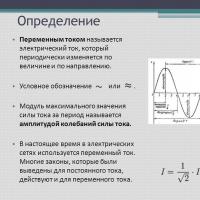

Présentation sur l'informatique "Qu'est-ce que la programmation ? Présentation sur le thème "dispositif et principe de fonctionnement du générateur"

Présentation sur le thème "dispositif et principe de fonctionnement du générateur" Présentation sur le thème "Réseau mondial INTERNET

Présentation sur le thème "Réseau mondial INTERNET Présentation "Le rôle de l'information dans la vie de la société" Présentation sur le thème de l'information dans la vie de la société

Présentation "Le rôle de l'information dans la vie de la société" Présentation sur le thème de l'information dans la vie de la société Des briques à nos jours : L'évolution des téléphones portables

Des briques à nos jours : L'évolution des téléphones portables